1 life 2 live

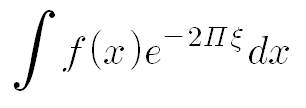

딥러닝에서의 X(곱셈)과 e^x의 의미, Cross Entropy, Laplace Transform, Fourier Transform, 정규화 등등 [21.3.16] 본문

딥러닝에서의 X(곱셈)과 e^x의 의미, Cross Entropy, Laplace Transform, Fourier Transform, 정규화 등등 [21.3.16]

대희투 2021. 3. 24. 23:21y = f(x1, x2, x3)

f -> existence -> uniqueness -> network로 표현 가능 -> taylor expension

f는 존재하지만 완벽한 f를 찾기는 어렵다. -> y hat의 등장

Error = |y - yhat|

Min(E^2)인 w를 구함 -> 이 작업을 직접할 수 없으닌 Adam같은 Optimizer 사용

이 중 혁신적인 생각!

서로 비슷한 값을 확인할 수 있는 방법을 찾음

ex) (1, 2) -> (1.1, 2.3) 과 비슷한가?

(1.1, -2.3) 과 비슷한가?

비슷한걸 어떻게 알 것인가?

답은 서로 곱해보는 것이다.

값이 높으면 비슷한거고 값이 낮아지면 비슷하지 않은 것이다.

이것을 Cross Entropy라고 한다.

Translation은 선형이고

Transformation은 비선형이다.

Laplace Transform은 hidden layer 역할을 한다.

적분을 하게되면 비선형이 e^(-x)축에 걸러져서 Harmony만 남게된다.

하모니가 좋은건 아니다.

Fourier Transform은 Laplace Transform의 하나로

반지름과 속도(코사이)를 조정한다.

이외에

Characteristic Function은

Probability function은

로 표현한다.

내용을 정리하면

-> INDEPENDENT 독립적

-> 미분 적분해도 e^x

-> 변하지 않음

-> 축 위에 있음

-> 변환 시(미적분시) 어느 부분은 가져가고 어느 부분은 버린다.

-> 딥러닝안에 존재하며 exist, unique하다

-> but 사용자가 정해야할 내용이 많고, 적절한 값을 못찾을 확률이 있다.

Cross Entropy -> 내적, 비슷한거 확인

Cross Product -> 외적, 차원 증가

딥러닝과 빅데이터(x,y) 중에서는 빅데이터가 좀 더 중요하다.

-> 차원(Topology) 중요하다.(x관련)

-> 정규화를 한다.

다음 이어서...

'스마트팩토리(스마트 제조)' 카테고리의 다른 글

| 2022 서울 코엑스 - 스마트 팩토리 자동화 엑스포 방문 후기 [22.4.8] (2) | 2022.05.20 |

|---|---|

| 스마트제조 솔루션 구성요소 용어 정리 [22.2.6] (0) | 2022.02.06 |

| 스마트 제조업와 디지털 트윈, 빅데이터의 이슈 그리고 철학자(2) [21.3.9] (0) | 2021.03.18 |

| 스마트 제조업와 디지털 트윈, 빅데이터의 이슈 그리고 철학자(1) [21.3.9] (1) | 2021.03.17 |

| 스마트 팩토리(제조업)의 잡다한 지식들... [21.3.2] (0) | 2021.03.15 |